Guide pratique pour respecter l'IA Act en 2025

L'ia act projet regulation intelligence artificielle représente une avancée majeure dans la régulation de l'intelligence artificielle. Cette réglementation vise à encadrer l'utilisation de l'IA au sein des entreprises, garantissant ainsi un usage responsable et éthique. En 2025, les entreprises de plus de 100 employés devront se conformer à cette loi, ce qui souligne l'importance de la préparation réglementaire. En effet, 22 % des salariés ont déjà utilisé un outil d'IA sans en informer leur supérieur, illustrant le besoin urgent d'une réglementation stricte.

La conformité à l'ia act projet regulation intelligence artificielle est cruciale pour éviter des sanctions sévères. Les amendes peuvent atteindre 35 millions d'euros ou 7 % du chiffre d'affaires mondial pour les violations les plus graves. Par conséquent, il est dans votre intérêt de vous préparer dès maintenant.

Points Clés

Commencez à vous préparer pour suivre l'IA Act. Cela peut vous éviter des amendes de 35 millions d'euros.

Utilisez l'IA de manière éthique. Cela aide à gagner la confiance de vos clients et partenaires.

Faites une évaluation des risques. Cela vous aide à voir les menaces possibles avec vos systèmes d'IA.

Écrivez vos processus. Cela rend vos systèmes d'IA plus transparents et faciles à vérifier.

Formez vos équipes. Elles doivent comprendre les enjeux et les règles de l'IA Act.

Catégories de risques

Les risques associés à l'IA Act se divisent en plusieurs catégories. Chacune présente des défis uniques que vous devez comprendre pour garantir la conformité.

Risques liés à la sécurité

Les systèmes d'IA peuvent être vulnérables à diverses menaces. Voici quelques risques majeurs :

Risque d'atteinte au droit à la vie privée et à la protection des données personnelles.

Risque de vol de données lié à des cyberattaques.

Risque d'atteinte à la dignité humaine, notamment par des systèmes d'IA pouvant nuire à l'intégrité physique ou psychique.

Ces menaces peuvent compromettre la sécurité de vos données et celle de vos clients. Il est essentiel de mettre en place des mesures de sécurité robustes pour protéger vos systèmes.

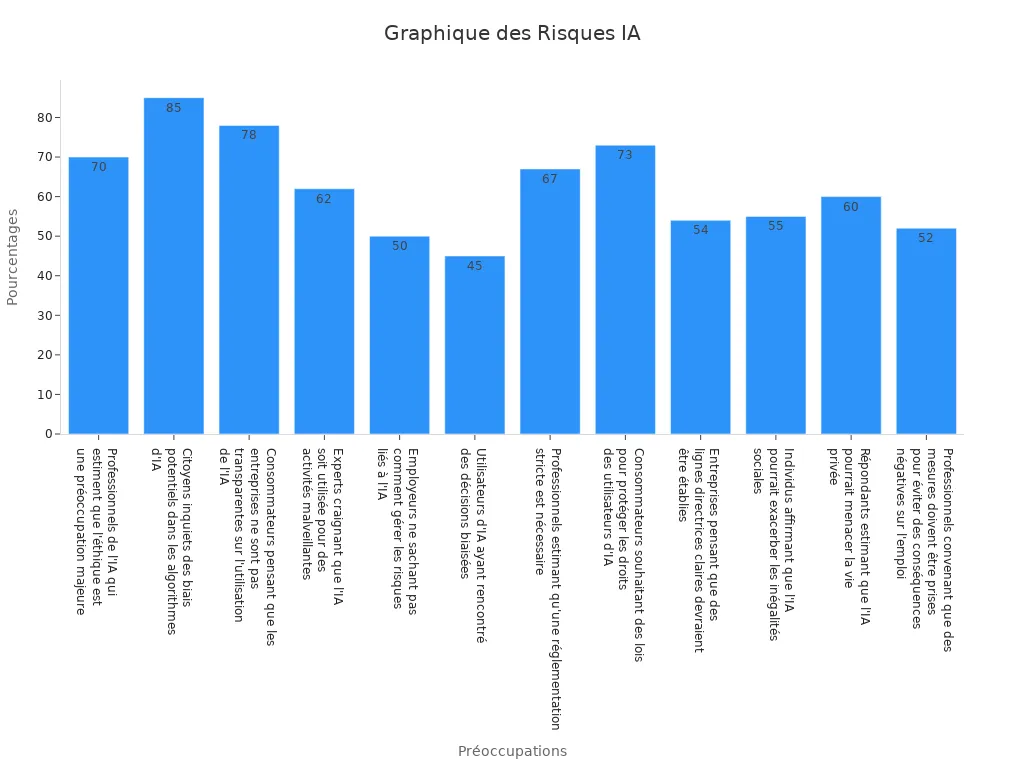

Risques éthiques

Les préoccupations éthiques autour de l'IA sont de plus en plus pressantes. Une étude récente révèle que 70 % des professionnels de l'IA estiment que l'éthique est une préoccupation majeure. Voici quelques statistiques clés :

Préoccupation/Risque | Pourcentage |

|---|---|

Citoyens inquiets des biais potentiels dans les algorithmes d'IA | 85% |

Consommateurs pensant que les entreprises ne sont pas transparentes sur l'utilisation de l'IA | 78% |

Experts craignant que l'IA soit utilisée pour des activités malveillantes | 62% |

Ces chiffres soulignent l'importance d'une approche éthique dans le développement et l'utilisation des systèmes d'IA. Vous devez être conscient des biais potentiels et de l'impact de vos décisions sur la société.

Risques de non-conformité

La non-conformité à l'IA Act peut entraîner des conséquences graves. Les sanctions financières peuvent être lourdes, atteignant jusqu'à 35 millions d'euros. De plus, le non-respect des réglementations peut nuire à votre réputation. Vous devez donc vous assurer que vos pratiques respectent les exigences légales.

En résumé, comprendre ces catégories de risques vous aidera à naviguer dans le paysage complexe de l'IA et à garantir une utilisation responsable de la technologie.

Obligations de conformité

Pour respecter l'IA Act, vous devez vous conformer à plusieurs obligations essentielles. Ces obligations garantissent que votre entreprise utilise l'intelligence artificielle de manière responsable et éthique.

Évaluation des risques

La première étape consiste à réaliser une évaluation des risques. Vous devez identifier les menaces potentielles liées à vos systèmes d'IA. Voici quelques actions à entreprendre :

Élaborer une matrice d’évaluation des risques.

Intégrer l’IA Act dans vos processus opérationnels.

Cette évaluation vous permettra de mieux comprendre les vulnérabilités de vos systèmes et de mettre en place des mesures préventives.

Documentation et transparence

La documentation précise et la transparence sont cruciales pour respecter l'IA Act. Vous devez garantir l'auditabilité de vos systèmes d'IA. Voici quelques points à considérer :

Les auditeurs doivent pouvoir analyser le fonctionnement des algorithmes et les données utilisées pour leur entraînement.

Le RGPD exige une transparence totale sur la collecte et l'utilisation des données personnelles, ce qui est essentiel pour la conformité avec l'IA Act.

La transparence est cruciale pour garantir l'auditabilité des systèmes d'IA.

En respectant ces exigences, vous renforcez la confiance de vos clients et partenaires.

Formation et sensibilisation

La formation et la sensibilisation de vos équipes sont indispensables. Vous devez vous assurer que vos employés comprennent les enjeux liés à l'IA. Voici quelques modules de formation recommandés :

Module 3 : Gouvernance éthique d’un projet digital.

Module 4 : Ateliers Cas pratiques.

Ces formations permettent à vos équipes d'acquérir les connaissances nécessaires pour anticiper et répondre aux exigences de l'IA Act. En investissant dans la formation, vous renforcez la culture de conformité au sein de votre entreprise.

Bonnes pratiques pour chaque catégorie

Sécurisation des systèmes d'IA

Pour sécuriser vos systèmes d'IA, adoptez des pratiques robustes. Voici quelques recommandations :

Limitez la collecte de données personnelles : Choisissez des méthodes d'IA qui atteignent vos objectifs sans surcharger vos systèmes de données sensibles.

Testez régulièrement vos systèmes : Effectuez des tests de résistance pour identifier les vulnérabilités. Cela garantit que vos systèmes résistent aux attaques potentielles.

Utilisez des techniques de visualisation : Fournissez des informations claires sur le fonctionnement de vos systèmes. Cela aide les utilisateurs à comprendre comment les décisions sont prises.

Ces pratiques renforcent la sécurité et la confiance dans vos systèmes d'IA.

Mise en place de politiques éthiques

L'éthique doit être au cœur de votre stratégie d'IA. Voici quelques éléments clés à considérer :

Éléments clés | Détails |

|---|---|

Droits fondamentaux | Tenez compte des droits fondamentaux et de l’autonomie humaine lors de la conception. |

Équité | Utilisez des données représentatives pour éviter les biais. Assurez une surveillance continue. |

Responsabilité | Identifiez les rôles des différents acteurs et mettez en place la documentation nécessaire. |

L'IA Act repose sur des valeurs fondamentales, intégrant l'éthique dans le cadre légal. Cela dépasse l'auto-régulation et renforce la responsabilité des entreprises.

Suivi et audit régulier

Le suivi et l'audit réguliers sont essentiels pour maintenir la conformité. Voici quelques bonnes pratiques :

Documentez vos choix de conception : Cela facilite les audits ex-ante et ex-post. La transparence est cruciale pour démontrer la conformité.

Charge de preuve : Assurez-vous que vous pouvez prouver que vos systèmes respectent les obligations légales. Cela inclut la sécurité, la transparence et la non-discrimination.

Évaluez régulièrement les performances : Utilisez des indicateurs de performance pour mesurer l'efficacité de vos systèmes d'IA.

Ces pratiques garantissent que vous restez conforme aux exigences de l'IA Act et que vous minimisez les risques associés.

Conséquences de la non-conformité

La non-conformité à l'IA Act peut entraîner des conséquences graves pour votre entreprise. Vous devez être conscient des risques financiers, réputationnels et juridiques qui peuvent découler de cette situation.

Sanctions financières

Les sanctions financières représentent l'une des conséquences les plus immédiates de la non-conformité. En cas de violation des règles établies par l'IA Act, vous pourriez faire face à des amendes pouvant atteindre 35 millions d'euros. Ces sanctions varient en fonction de la gravité de l'infraction. Par exemple, les systèmes d’IA classés à haut risque, comme ceux utilisés dans le domaine de la justice, sont soumis à des obligations strictes. Le non-respect de ces obligations peut entraîner des pénalités financières significatives.

Impact sur la réputation

La réputation de votre entreprise est un atout précieux. En cas de non-conformité, vous risquez de perdre la confiance de vos clients et partenaires. Une étude récente a montré que 78 % des consommateurs estiment que les entreprises ne sont pas transparentes sur l'utilisation de l'IA. Si votre entreprise est perçue comme négligente dans le respect des réglementations, cela peut nuire à votre image de marque. Vous devez donc agir de manière proactive pour éviter de telles situations.

Risques juridiques

Les risques juridiques associés à la non-conformité sont également préoccupants. Les systèmes d’IA utilisés dans des domaines sensibles, comme la justice, sont classés à haut risque selon le Règlement (UE) 2024/1689. Cela signifie que toute violation peut avoir des répercussions juridiques importantes. Vous devez être conscient que l'IA Act impose des obligations différenciées selon les niveaux de risque des systèmes d'IA. En cas de non-respect, des actions en justice peuvent être engagées contre votre entreprise, entraînant des coûts supplémentaires et des complications juridiques.

En résumé, la non-conformité à l'IA Act peut avoir des conséquences financières, réputationnelles et juridiques graves. Il est essentiel de prendre des mesures pour garantir que votre entreprise respecte ces réglementations.

Feuille de route pour la conformité

Pour garantir votre conformité à l'IA Act, il est essentiel de suivre une feuille de route structurée. Voici les étapes clés à considérer :

Cartographie des systèmes d'IA

Commencez par réaliser une cartographie complète de vos systèmes d'IA. Cette étape vous permet d'identifier les systèmes existants et ceux en projet. Voici les étapes à suivre :

Évaluer les niveaux de risque des systèmes et modèles d’IA.

Classer les systèmes d’IA en fonction de leur niveau de risque.

Mettre en conformité les systèmes classés à haut risque.

Les critères d'évaluation des risques incluent le secteur d'activité, les cas d'utilisation, la puissance du modèle d’IA et les types de données utilisées. Cette cartographie vous aidera à visualiser les risques potentiels et à prioriser vos actions.

Renforcement de la gouvernance

Le renforcement de la gouvernance est crucial pour respecter l'IA Act. Voici quelques mesures à adopter :

Désignez un pilote pour la gouvernance de l'IA au sein de votre organisation.

Sensibilisez les parties prenantes aux implications de l'IA Act.

Établissez des processus de mise en conformité, incluant l'analyse des risques et la documentation technique.

Ces actions garantissent que votre entreprise adopte une approche proactive face aux exigences réglementaires. Une gouvernance solide favorise également la transparence et la responsabilité.

Collaboration avec des experts

La collaboration avec des experts est un atout précieux pour naviguer dans le paysage complexe de l'IA. Plusieurs initiatives existent pour soutenir votre démarche de conformité :

Le Cigref a collaboré avec Numeum pour créer un guide pratique sur l'IA Act.

Quatre cabinets d'avocats, dont August Debouzy et DLA Piper, ont été impliqués pour fournir des conseils juridiques.

Ces collaborations vous permettent d'accéder à des ressources et à des conseils d'experts, renforçant ainsi votre capacité à respecter l'IA Act projet regulation intelligence artificielle.

En résumé, la conformité à l'IA Act est essentielle pour protéger votre entreprise et vos clients. Voici quelques points clés à retenir :

Évitez les sanctions : Respectez les réglementations pour éviter des amendes lourdes.

Renforcez votre réputation : Une approche éthique attire la confiance des clients.

Optimisez vos systèmes : L'utilisation responsable de l'IA améliore l'efficacité opérationnelle.

Adoptez une approche proactive dès aujourd'hui. Investissez dans la formation et la gouvernance pour garantir une utilisation éthique et sécurisée de l'IA. Les bénéfices d'une telle démarche sont nombreux et contribueront à un avenir meilleur pour votre entreprise et la société.

FAQ

Qu'est-ce que l'IA Act ?

L'IA Act est une réglementation européenne qui encadre l'utilisation de l'intelligence artificielle. Elle vise à garantir un usage éthique et responsable de l'IA au sein des entreprises.

Pourquoi la conformité à l'IA Act est-elle importante ?

La conformité est essentielle pour éviter des sanctions financières pouvant atteindre 35 millions d'euros. Elle protège également votre réputation et renforce la confiance des clients.

Comment évaluer les risques liés à l'IA ?

Pour évaluer les risques, identifiez les menaces potentielles, élaborez une matrice d’évaluation et intégrez l’IA Act dans vos processus opérationnels. Cela vous aidera à anticiper les vulnérabilités.

Quelles sont les obligations de documentation ?

Vous devez garantir la transparence sur la collecte et l'utilisation des données. Documentez les algorithmes et les données utilisées pour assurer l'auditabilité de vos systèmes d'IA.

Comment former mes équipes sur l'IA Act ?

Organisez des modules de formation sur les enjeux éthiques, le cadre réglementaire et la gouvernance de l'IA. Cela permettra à vos employés de mieux comprendre les exigences de conformité.

Voir également

Manuel Essentiel Pour Appliquer CQQCOQP En 2025

Stratégies Pour Traduire Votre Site Internet En 2025

Identifier Les Indices D'Abus En Ligne En 2025

Innovations En Intelligence Artificielle De Google En Février 2025